Ética e Inteligencia Artificial: Buenas prácticas y herramientas para hacer marketing con equilibrio

La inteligencia artificial es ahora parte integral de nuestra vida diaria y está al alcance de todos. Para una pequeña empresa, esta facilidad de uso de la IA representa un recurso increíble, especialmente en el fértil campo del marketing, donde permite lograr mucho incluso con recursos limitados y un equipo pequeño. Probablemente ya la estés utilizando, o al menos estés pensando en cómo integrarla en tu estrategia para hacer recomendaciones de productos más relevantes, crear contenido hiperpersonalizado o añadir un asistente virtual a tu sitio web.

O quizás seas uno de los muchos que se plantean preocupaciones éticas concretas. ¿Qué significa el uso de la inteligencia artificial para la privacidad? ¿Para la creatividad? ¿Para la transparencia y la equidad? ¿Para el medio ambiente?

En este artículo, abordaremos el tema desde dos perspectivas: filosófica y práctica. Analizaremos las implicaciones éticas más relevantes y los requisitos legales europeos definidos por la Ley de IA (AI Act), y mostraremos cómo utilizar herramientas de IA como chatbots, ChatGPT, algoritmos de segmentación y análisis de datos de forma responsable, clara y aplicable al día a día de tu empresa, sin recurrir a jerga técnica ni compleja.

El objetivo es proporcionarte un marco concreto para integrar éticamente la IA en el marketing, protegiendo a los clientes y las marcas, sin sacrificar la eficiencia ni la creatividad.

El marco esencial

Normativa: La Ley de IA de la Comisión Europea y las recomendaciones de la UNESCO proporcionan el marco legal y los principios éticos que abarcan la privacidad de los datos, la equidad, la transparencia, la confiabilidad y la responsabilidad.

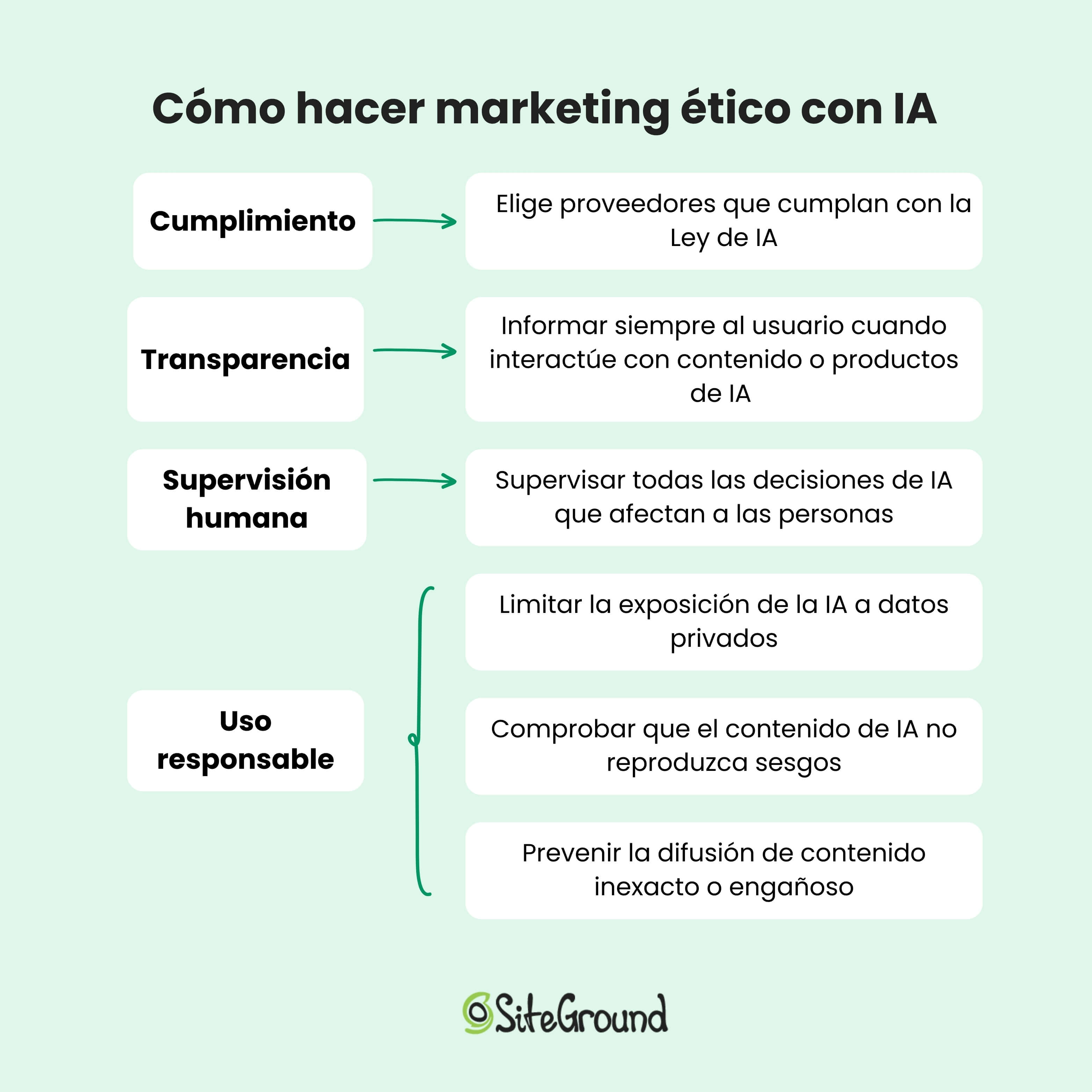

Consideraciones para el marketing ético con IA: Elegir herramientas que cumplan con las normas, ser transparente con los usuarios, mantener la supervisión humana, respetar los datos privados, producir contenido no discriminatorio ni engañoso.

Mejores prácticas para la adopción ética de IA en tu empresa: Mapear los usos actuales y futuros, involucrar a los equipos clave, definir principios éticos de uso y comunicar tu compromiso interna y externamente.

Consejos de casos prácticos: Supervisar los resultados de IA, recopilar datos de forma responsable, etiquetarlos y protegerlos, controlar el sesgo y evitar la manipulación, realizar auditorías de imparcialidad, aclarar su funcionamiento, mantener la participación humana, actualizar el contenido, utilizar herramientas de detección de plagio, utilizar modelos RAG para garantizar respuestas precisas.

¿Qué son las integraciones de IA en marketing?

Cuando hablamos de integrar inteligencia artificial en marketing, abarcamos una amplia gama de aplicaciones, desde la creación de textos más impactantes hasta la capacidad de predecir quién tiene más probabilidades de completar una compra. Todo esto con una velocidad y escalabilidad que hasta hace unos años estaban fuera del alcance de cualquier equipo, especialmente de las pequeñas empresas.

Hoy en día, estas herramientas pueden automatizar, analizar, personalizar, generar contenido (escrito, con imágenes, video, audio) y predecir el comportamiento. Las actividades de marketing que pueden transformarse con estas tecnologías incluyen:

- La segmentación de campañas

- La producción de contenido

- El desarrollo y optimización de estrategias SEO

- La planificación editorial

- La segmentación de audiencias

- La gestión de campañas publicitarias

- La creación de informes avanzados

- La optimización continua del funnel de marketing

Básicamente, cualquier cosa que requiera análisis rápido, iteraciones frecuentes y personalización que un equipo humano por sí solo no podría mantener con la misma eficiencia. En SiteGround, hemos desarrollado herramientas para que cualquier profesional pueda aprovechar el potencial de la IA con total seguridad. Con herramientas como SiteGround AI Studio, puedes acceder a un espacio de trabajo diseñado para optimizar tu flujo de marketing mediante agentes especializados.

Para quienes buscan llevar sus ideas del concepto a la realidad en tiempo récord, contamos con Coderick AI, que actúa como tu propio desarrollador experto, permitiéndote construir y lanzar dashboards personalizados y herramientas interactivas de captación completos a partir de un simple prompt.

¿Cuál es el papel de la ética en la inteligencia artificial?

La ética de la inteligencia artificial es un campo relativamente nuevo y multidisciplinario que estudia cómo maximizar los efectos positivos de la IA mientras se minimizan los riesgos y las consecuencias negativas, se previene la discriminación y se garantiza la transparencia.

En los últimos años, con la creciente integración de la IA en el ámbito laboral, el interés por la ética y la inteligencia artificial (IA) ha crecido exponencialmente, primero en las comunidades de investigación y ciencia de datos, y luego a nivel mundial. Si bien hace un tiempo el tema podría haberse considerado puramente filosófico, ahora afecta a cualquier empresa que utilice tecnologías de IA, y se han introducido regulaciones y leyes específicas para garantizar su uso responsable.

En 2021, la UNESCO publicó una serie de recomendaciones, dirigidas principalmente a estados e instituciones, para que sirvan de guía en el desarrollo de leyes y estrategias sobre inteligencia artificial. A estas recomendaciones se unió en 2024 la Ley de IA de la Comisión Europea, una normativa vinculante que establece obligaciones y sanciones precisas en caso de incumplimiento. Por lo tanto, integrar principios éticos significa no solo cumplir con la ley, sino también proteger la reputación de tu empresa y fortalecer la confianza de los clientes.

| Principales cuestiones éticas relacionadas con la IA | |

| Privacidad y responsabilidad de los datos | Asegúrate de que los datos recopilados se procesen correctamente y de que las decisiones automatizadas sean rastreables. Por ejemplo, un sistema de email marketing debe registrar quién autorizó el procesamiento de datos, así como quién interactuó con el contenido. |

| Equidad | Evitar la discriminación contra usuarios o segmentos del mercado. Un algoritmo de segmentación no debe favorecer a un grupo sobre otro. |

| Usabilidad de la información | Comprender cómo la IA toma decisiones. |

| Robustez | Garantizar que los sistemas de IA sean fiables y resistentes a errores o ataques para proteger los datos recopilados. |

| Transparencia | Informar claramente cuándo el contenido o una decisión provienen de una IA. |

| Sostenibilidad ambiental | El consumo de energía y agua que utiliza la IA. |

| Inclusión | Diseñar sistemas accesibles para todos, evitando la exclusión de usuarios por motivos culturales, étnicos, económicos, físicos, de género u orientación sexual. |

| Arbitrariedad moral | Evaluar el impacto de las decisiones automatizadas y decidir cuándo es necesaria la intervención humana. |

| Alineación con los valores | Garantizar que la IA respete los principios corporativos y sociales. |

| Responsabilidad | Saber quién es responsable en caso de error o daño. |

| Confianza | Construir relaciones sólidas con clientes y usuarios mediante prácticas justas. |

| Uso inadecuado de la tecnología | Prevenir la manipulación o las aplicaciones injustas, como el spam invasivo o la elaboración de perfiles agresivos. |

Algunas cuestiones éticas, como la sostenibilidad ambiental, afectan no tanto al nivel individual como al del proveedor: cada consulta de un modelo como ChatGPT consume agua y energía, pero estas cantidades son insignificantes en comparación con el consumo necesario para entrenar los modelos de IA. En estos casos, la responsabilidad recae en los proveedores y las empresas que gestionan los centros de datos.

Sin embargo, existen muchas acciones concretas que puedes implementar de inmediato a nivel empresarial para utilizar la IA de forma ética. En la siguiente sección, analizaremos los principios y regulaciones básicos de la ética de la IA aplicables al marketing, seguidos de casos prácticos sobre cómo implementarlos en tu trabajo diario.

Principios y directrices para el marketing ético con IA

Desde una perspectiva regulatoria, la Ley de IA de la Comisión Europea adopta un enfoque basado en el riesgo. Los sistemas de IA se clasifican en cuatro categorías (riesgo inaceptable, alto, limitado y mínimo), estableciendo diferentes obligaciones o prohibiciones según su gravedad.

El reglamento se aplica no solo a quienes desarrollan tecnologías de IA, sino también a quienes utilizan herramientas de terceros como chatbots, generadores de contenido o plataformas de marketing basadas en IA (en este caso, tú).

Por supuesto, las directrices son mucho más estrictas para los desarrolladores de tecnología de IA, mientras que quienes simplemente utilizan aplicaciones de IA se enfrentan a obligaciones más leves, pero aún concretas. En el caso del marketing y, en particular, de las pymes, la mayoría de los sistemas se clasifican en la categoría de riesgo limitado (chatbots, IA generativa, personalización) o riesgo mínimo (herramientas de productividad). Las principales obligaciones son:

- Elige proveedores que cumplan con la normativa: si utilizas herramientas de alto riesgo (por ejemplo, plataformas de segmentación avanzada que perfilan a los usuarios basándose en datos sensibles), debes recurrir a proveedores que ya cumplan con la Ley de IA.

- Transparencia: informa siempre a los usuarios cuando interactúen con un chatbot e identifica claramente el contenido generado por IA, evitando que se confunda con comunicaciones humanas.

- Supervisión humana: las decisiones cruciales que impactan a las personas (como ofertas altamente personalizadas basadas en una segmentación sensible, mensajes automatizados a clientes vulnerables, promociones vinculadas a comportamientos de compra especialmente sensibles o datos psicográficos) no deberían dejarse exclusivamente en manos de la IA. La intervención humana es lo que convierte a la IA en una herramienta de apoyo, no en un sustituto del juicio, la creatividad o la experiencia profesional.

- Uso responsable: incluye el respeto a la privacidad (cumplimiento del RGPD y otras normativas regionales, así como la limitación de la exposición de datos privados al utilizar herramientas de IA externas), la equidad y la no discriminación (evitar contenido discriminatorio, estereotipos o la reproducción de sesgos debido a datos de entrenamiento sesgados) y la protección de la autonomía del usuario (evitar la difusión de contenido inexacto, engañoso o manipulador).

Estos principios constituyen la base de un marketing responsable y sostenible basado en IA, esencial para construir una marca fiable y duradera, capaz de generar confianza y consolidar una reputación a largo plazo.

Cómo integrar las consideraciones éticas de la IA en el marketing

Establecer un marco ético corporativo para el uso de la inteligencia artificial puede parecer una tarea compleja, pero en realidad se trata de establecer normas claras y garantizar que todos en la empresa las conozcan. Estos son los pasos clave:

- Mapea los usos de la IA en tu empresa: identifica dónde ya utilizas la IA, incluso de forma informal, y dónde planeas implementarla en el futuro. Comprender los casos de uso específicos (atención al cliente, análisis de datos, automatización del marketing) es el primer paso para identificar posibles riesgos éticos.

- Involucra a todos los equipos: crea un grupo pequeño con experiencia diversa, que incluya IT, RR. HH., departamento legal o de cumplimiento normativo (si corresponde) y dirección. Esto proporcionará una visión integral y equilibrada de los riesgos y las oportunidades.

- Define principios éticos innegociables para la empresa: con base en las directrices generales y los valores de la marca, elige los principios más relevantes que se convertirán en el punto de referencia para todas las decisiones relacionadas con la IA.

- Comunica tu compromiso interna y externamente: Explica a los empleados por qué la ética es importante y cómo afectará su trabajo. Comunica también tu enfoque responsable a clientes y socios, fortaleciendo la confianza y la reputación.

No todas las herramientas de IA ni todos los escenarios de uso conllevan los mismos riesgos ni plantean las mismas cuestiones éticas. Para que estas recomendaciones sean realmente operativas, las analizamos caso por caso, evaluando los beneficios, los riesgos y los puntos ciegos éticos de cada uso. De esta manera, la ética deja de ser un concepto abstracto para convertirse en algo concreto y directamente aplicable a las actividades cotidianas de marketing.

Caso práctico 1: Creación de contenido e IA generativa

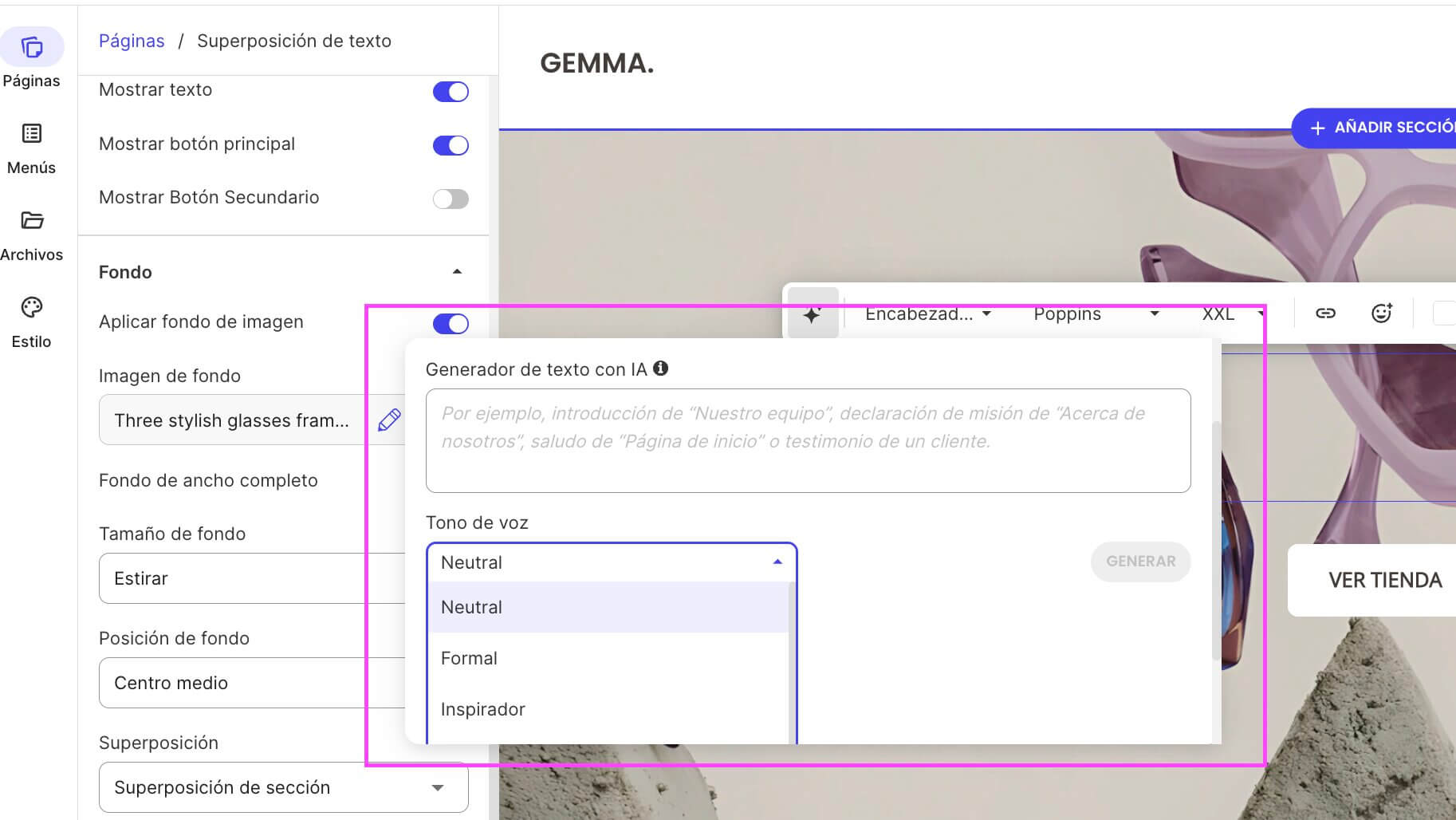

Las herramientas de IA generativa como ChatGPT, Jasper o DALL·E son ahora parte integral de cualquier equipo de marketing. Se utilizan con mayor frecuencia para descripciones de productos, publicaciones de blogs y campañas publicitarias.

SiteGround AI Studio ofrece una solución diseñada para simplificar estos procesos bajo un entorno controlado. A través de su Copywriting Agent, es posible generar textos alineados con la voz de tu marca de forma instantánea. Para la parte visual, el Designer Agent y el Logo Agent permiten crear identidades gráficas y elementos visuales profesionales sin necesidad de software complejo, asegurando que la creatividad y la rapidez vayan de la mano en tu estrategia digital.

Riesgos principales

- Transparencia: Los lectores pueden asumir que el contenido fue creado por un ser humano, lo que compromete la confianza y la credibilidad, especialmente en entornos informativos, educativos, de liderazgo intelectual o de atención al cliente.

- Seguridad de la información: Publicar datos confidenciales en plataformas públicas puede exponer a tu empresa y a tus clientes a riesgos de privacidad o uso indebido.

- Plagio y originalidad: El contenido generado puede replicar material existente con demasiada precisión, lo que puede generar problemas de derechos de autor o falta de atribución.

- Autenticidad de la marca: Sin supervisión humana, el contenido puede carecer de matices, emoción o coherencia con el tono de la marca.

Consejos prácticos

- Etiqueta claramente el contenido generado por IA cuando corresponda.

- Limita el uso de datos confidenciales en herramientas no seguras: trata a la IA como un colaborador externo, con reglas y límites claros.

- Formula prompts precisos para obtener resultados personalizados y luego haz modificaciones para que sean verdaderamente originales.

- Mantén siempre el control humano: La IA es una herramienta creativa, no un sustituto del pensamiento y la perspectiva humana.

- Utiliza detectores de plagio y herramientas de edición para garantizar la calidad y la originalidad.

💡Consejo💡

Con la creciente prevalencia del contenido impulsado por IA en blogs, landing pages y recursos de campaña, es importante asegurarse de seguir destacando en los resultados de búsqueda. Aquí es donde entra en juego la optimización para el nuevo SEO y los motores de búsqueda generativos (GEO) como ChatGPT, Perplexity y la AI Overview de Google.

Caso práctico 2: Análisis predictivo

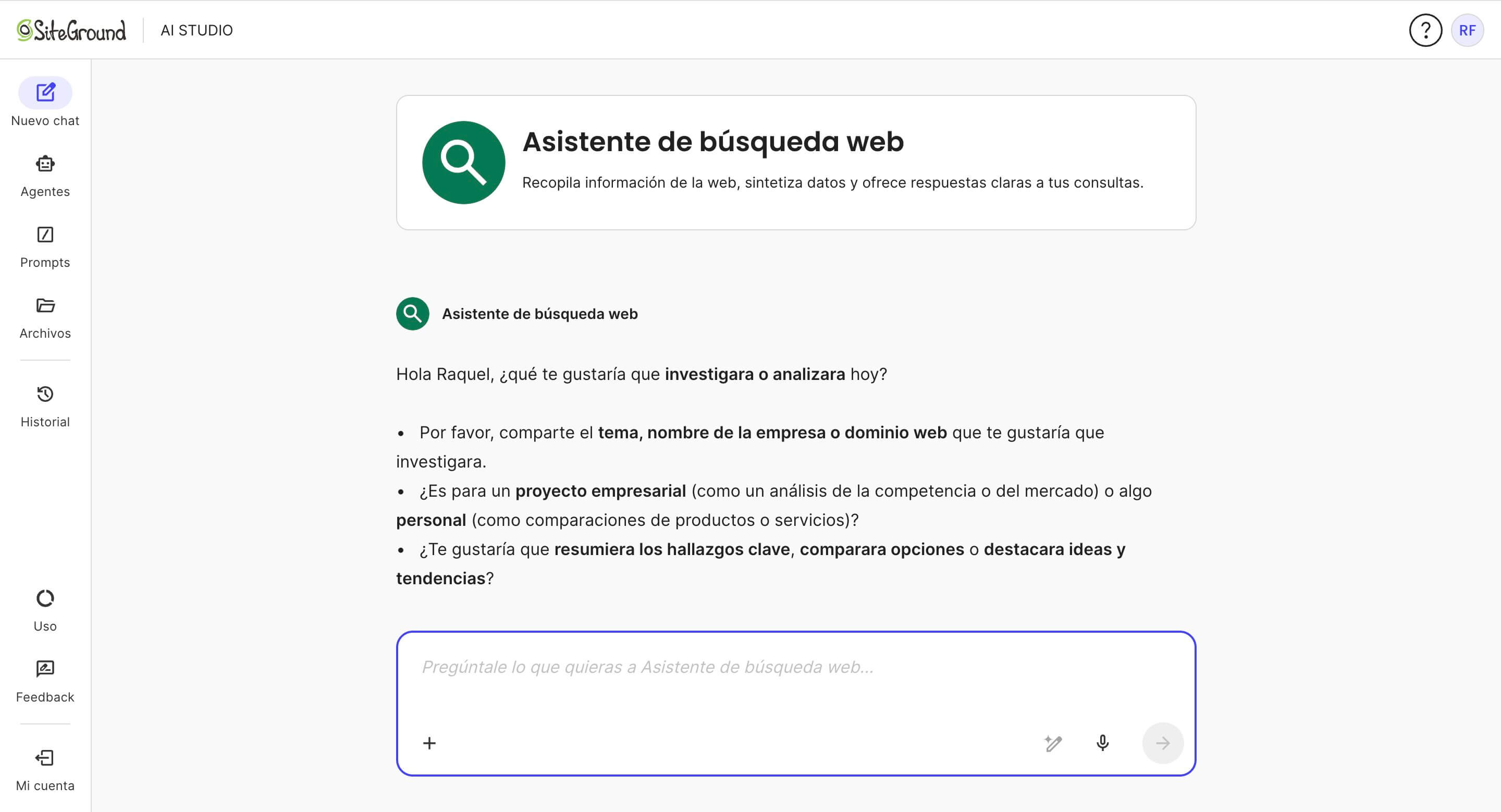

El análisis predictivo basado en IA te permite identificar tendencias, segmentar clientes y predecir comportamientos, desde el riesgo de abandono hasta la probabilidad de compra. Herramientas como el Asistente de búsqueda web de SiteGround AI Studio sirven precisamente para entender mejor el mercado. Este agente es capaz de rastrear y sintetizar grandes volúmenes de datos online, permitiéndote identificar patrones de consumo y movimientos de la competencia con una precisión que antes requería días de investigación manual.

Riesgos principales

- Privacidad de los datos: Los modelos predictivos utilizan grandes cantidades de datos demográficos y de comportamiento, a menudo recopilados de forma pasiva. Si los clientes no son conscientes de ello o no han dado su consentimiento explícito, podrían infringir las normas de privacidad.

- Sesgo: Los datos de entrenamiento que reflejan desigualdades reales pueden provocar que el modelo reproduzca la discriminación. Por ejemplo, un algoritmo que identifica solo a los hombres como destinatarios ideales para cursos o servicios profesionales, mientras que ignora a las mujeres, se basa en un sesgo incorrecto.

- Sobresegmentación: Predecir el comportamiento no implica manipular a los clientes. Una segmentación demasiado personalizada puede ser invasiva o explotar vulnerabilidades emocionales, como dirigirse a los usuarios durante sesiones nocturnas para estimular compras impulsivas.

Consejos prácticos

- Aclara el consentimiento: Asegúrate de que los datos se recopilen de forma ética y transparente. Actualiza las políticas de privacidad para que reflejen el uso real de los datos.

- Realiza pruebas de imparcialidad: Realiza auditorías periódicas del modelo para identificar resultados discriminatorios y ajusta los conjuntos de datos o algoritmos si es necesario.

- Sé consciente de la presión que creas: Utiliza los modelos para ayudar a los clientes a encontrar lo que necesitan, no para crear una urgencia artificial ni presión para comprar.

- Realiza revisiones interfuncionales: Incluye consideraciones legales, de cumplimiento y éticas, especialmente en casos delicados, para garantizar que las herramientas predictivas sean coherentes con los valores y responsabilidades corporativos.

Caso práctico 3: Personalización

A todos nos gustan los buenos consejos, como elegir el producto perfecto o un anuncio que parezca hecho a medida. Pero existe una delgada línea entre lo útil y lo invasivo.

Riesgos principales

- Manipulación: Guiar al cliente hacia un producto es útil, pero presionarlo para que gaste más o haga clic rápidamente aprovechando desencadenantes emocionales se convierte en explotación.

- Equidad: Los algoritmos determinan quién ve qué, pero pueden favorecer a ciertos grupos demográficos o reforzar estereotipos (por ejemplo, el género) y contribuir a una experiencia desagradable.

- Transparencia de datos: Los usuarios necesitan saber cómo y por qué ven cierto contenido. Si el algoritmo parece saber demasiado sin tu consentimiento, esto genera preocupaciones sobre la privacidad.

Consejos prácticos

- Orienta sin forzar: utiliza la personalización para sugerir, no para dictar. Por ejemplo, “Esto es lo que podría gustarte” es mejor que “Compra ahora o te lo pierdes”.

- Realiza una auditoría de imparcialidad: comprueba quién recibe ciertas recomendaciones y quién no, probando diferentes perfiles para garantizar que el motor no sea discriminatorio.

- Explica el funcionamiento: un simple mensaje, “Te recomendamos esto basándonos en tus últimas visualizaciones”, aumenta la transparencia y la confianza, reduciendo la sensación de invasividad.

Caso práctico 4: Chatbots y asistentes virtuales

Los chatbots y los asistentes virtuales con IA son ahora omnipresentes, respondiendo preguntas frecuentes, ayudando a rastrear pedidos y guiando las decisiones de compra. Son eficientes, están disponibles 24/7 y son capaces de gestionar una cantidad sorprendente de solicitudes sin intervención humana.

Riesgos principales

- Divulgación: Los usuarios a menudo asumen que están hablando con una persona. Si el bot no se identifica claramente como IA, puede generar frustración y desconfianza, especialmente en conversaciones delicadas.

- Precisión: Los bots reflejan la calidad de los datos y las reglas con las que fueron entrenados. Las respuestas incompletas, desactualizadas o incorrectas pueden tener consecuencias reales en las decisiones de los clientes.

- Falta de empatía: Los bots carecen de emoción, pero se utilizan en situaciones delicadas como quejas o problemas con productos. Las respuestas demasiado robóticas resultan frías, y las respuestas demasiado humanas de un bot pueden parecer manipuladoras y desagradables, lo que socava la confianza y las futuras ventas.

Consejos prácticos

- Sé claro desde el principio: configura los chatbots para que inicien cada interacción con “¡Hola! Soy un asistente de IA, estoy aquí para ayudarte” y así gestionar las expectativas y generar confianza.

- Establece límites inteligentes: asegúrate de que los chatbots sepan cuándo delegar la conversación a un humano, especialmente en asuntos complejos, delicados o emotivos.

- Entrena a los bots con cuidado: utiliza modelos RAG para garantizar respuestas coherentes con las políticas y actualiza el contenido y el inventario con regularidad.

- Encuentra el equilibrio en la inteligencia emocional: configura los chatbots para que respondan con respuestas comprensivas (usa mensajes como “Esto que te ha pasado es frustrante…”), pero sin ignorarlos ni hacer creer a los usuarios que están hablando con una persona. Si un usuario muestra una frustración grave, transfiere siempre la conversación a un humano.

Caso práctico 5: Algoritmos de segmentación publicitaria

La segmentación publicitaria basada en IA es lo que hace que los anuncios sean sorprendentemente relevantes: el descuento en zapatos que estabas a punto de comprar el otro día, el anuncio de esa freidora de aire que buscaste solo una vez en Google, el anuncio de ese vuelo en el que solo pensaste el otro día mientras esperabas en el dentista. Este tipo de segmentación es potente y eficiente, pero la precisión puede generar dudas sobre la privacidad, la imparcialidad y la concienciación del usuario.

Riesgos principales

- Vigilancia: el seguimiento del comportamiento en sitios web, aplicaciones y dispositivos puede parecer acoso digital. Cuando las personas se sienten observadas en lugar de comprendidas, la confianza disminuye.

- Sesgo algorítmico: los modelos aprenden de los datos que reflejan desigualdades reales. Esto puede llevar a que ciertos grupos sean excluidos, estereotipados o manipulados, como al dirigirse agresivamente a usuarios financieramente vulnerables con ofertas de crédito que los empujan al endeudamiento.

- Transparencia: muchos usuarios desconocen por qué ven un anuncio, qué datos se utilizaron ni cómo controlar la segmentación. Los procesos opacos aumentan la percepción de manipulación.

Consejos prácticos

- Recopilación responsable de datos: limita la recopilación de datos al mínimo necesario, informa claramente a los usuarios y ofrece un control real sobre las preferencias de seguimiento y segmentación.

- Realiza auditorías periódicas: supervisa quién llega a las campañas y quién queda excluido, corrigiendo cualquier sesgo o limitación involuntaria. Implementa herramientas de transparencia: ofrece a los usuarios formas claras de comprender y gestionar su experiencia publicitaria, como enlaces “¿Por qué veo esto?” o configuraciones personalizadas.

- Equilibra la relevancia con el respeto: una segmentación inteligente implica ofrecer valor, no solo visibilidad, evitando sensaciones intrusivas.

Ética e Inteligencia Artificial: El futuro del marketing

La inteligencia artificial no va a desaparecer y, en consecuencia, tampoco las implicaciones éticas que conlleva. En marketing, tenemos la oportunidad de definir cómo se manifiesta la IA en las interacciones con personas reales y cuánta confianza genera o pierde en el proceso. Esto nos exige plantear preguntas, promover la transparencia e integrar la ética desde el principio en cada proyecto.

En SiteGround, la IA es una parte integral de nuestras soluciones, con un enfoque consciente y responsable:

- Seguridad web: AI Antibot bloquea millones de ataques de fuerza bruta antes de que lleguen a los sitios web de los clientes.

- Registro de dominios: las herramientas de IA sugieren nombres de dominio relevantes, memorables y coherentes con la marca.

- Creación de contenido y campañas: A través de los agentes especializados en copywriting, diseño de imágenes y logotipos, email marketing y campañas publicitarias (todo bajo AI Studio), facilitamos la generación de contenido claro, seleccionado y listo para usar. Todo esto se integra perfectamente con nuestro Website Builder y la herramienta de Email Marketing.

- Creación web y aplicaciones: Con Coderick AI, abrimos la puerta al vibe-coding, permitiendo a cualquier usuario crear landing pages y aplicaciones web completas simplemente describiendo su idea.

Pero la eficiencia no es suficiente, siempre nos aseguramos de que el uso de la IA sea ético y transparente, respetando los principios fundamentales de privacidad, equidad y confianza, para que cada interacción y decisión automatizada sea segura, esté supervisada y se ajuste a nuestros valores.

Si diriges una pequeña o mediana empresa que busca aprovechar la IA en marketing sin sacrificar la seguridad, la fiabilidad y la gestión responsable de datos, elegir un proveedor de hosting y servicios web experto como SiteGround significa confiar en alguien que combina tecnología de vanguardia con principios éticos, acompañándote en cada paso de tu transformación digital.

Comentarios ( 0 )

¡Gracias! Tu comentario esta pendiente de ser moderado y será publicado en breve si esta relacionado con el artículo del blog. Comentarios sobre soporte o incidencias no serán publicados. En tal caso, por favor repórtalo directamente a través de nuestros canales oficiales de comunicación.

Deja un comentario

¡Gracias! Tu comentario esta pendiente de ser moderado y será publicado en breve si esta relacionado con el artículo del blog. Comentarios sobre soporte o incidencias no serán publicados. En tal caso, por favor repórtalo directamente a través de nuestros canales oficiales de comunicación.